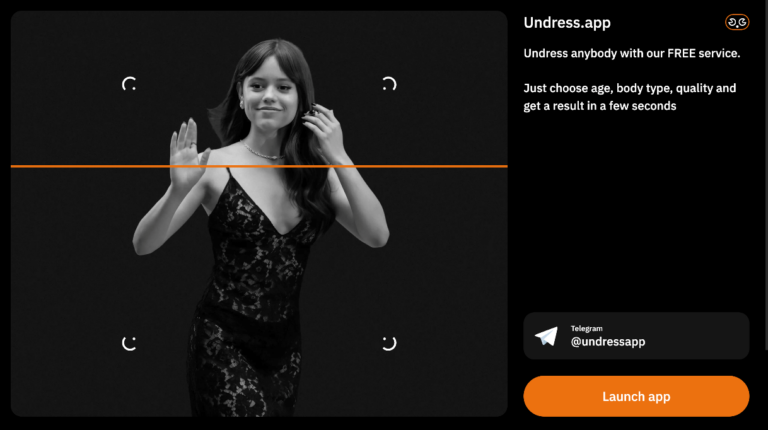

Revue d’Undress AI : un guide de sécurité pour les parents préoccupés

Avec le développement de l’intelligence artificielle, Undress AI est apparu dans notre champ de vision. Compte tenu de sa nature, de plus en plus de personnes s’inquiètent de ses risques.

Cette analyse est un guide de sécurité objectif destiné aux parents et aux tuteurs. Nous nous concentrons sur l’évaluation des risques juridiques liés à la vie privée d’Undress AI afin d’aider à protéger les mineurs. Cet article ne fait pas la promotion de ces outils et n’en fournit pas l’accès.

Partie 1. Réponse rapide

Undress AI n’est pas sans danger pour les enfants. Ces outils peuvent être utilisés pour créer des images sexualisées non consenties, y compris des contenus impliquant des mineurs, et ils comportent de graves risques liés à la vie privée, à l’émotionnel et au droit.

Pour les parents, la priorité n’est pas de comprendre « comment fonctionne l’outil », mais de prévenir l’exposition, d’identifier les signaux d’alerte, de conserver les preuves et de réagir rapidement si un enfant devient une cible.

Ce que les parents doivent savoir :

- Ces outils peuvent être utilisés pour le harcèlement, le chantage et l’exploitation sexuelle.

- Les contenus impliquant des mineurs peuvent être illégaux et profondément nocifs.

- Les outils de signalement et de suppression sont importants, mais la prévention et la détection précoce le sont encore plus.

- Les protections au niveau des appareils peuvent réduire l’exposition et offrir des signaux d’alerte précoces aux parents.

Partie 2. Qu’est-ce qu’Undress AI ?

Avec la technologie d’intelligence artificielle de type « deep nude », Undress AI est un outil qui modifie des photos pour simuler un déshabillage numérique. Ce programme d’intelligence artificielle utilise des réseaux de neurones convolutifs (CNN) pour modifier les images avec précision.

Aujourd’hui, Undress AI est principalement utilisé pour retirer numériquement les vêtements sur des images de personnes. Selon les besoins des utilisateurs, il peut générer des photos avec différentes apparences ou modifications vestimentaires. Il peut facilement transformer des photos ordinaires de personnes habillées (comme n’importe quelle photo publiée sur les réseaux sociaux) en images nues ou sexualisées.

Les recherches indiquent que 99 % des victimes d’Undress AI sont des femmes, voire des filles. Dans la grande majorité des cas, ces photos ou vidéos sont utilisées pour harceler, contraindre ou faire chanter les victimes.

Pire encore, un rapport de l’Internet Watch Foundation a identifié plus de 11 000 images générées par IA potentiellement illégales d’enfants sur un forum du dark web dédié à la diffusion de contenus d’abus sexuels sur enfants (CSAM).

Partie 3. Dangers potentiels

Bien que cette technologie démontre les progrès de l’IA dans le traitement d’images, elle soulève de graves problèmes éthiques et de respect de la vie privée.

Selon des rapports de Graphika et de l’IWF, l’essor d’Undress AI n’est plus un phénomène marginal. En 2025, les sites liés au « nudify » ont reçu plus de 24 millions de visites en un seul mois, et les contenus explicites générés par IA ont augmenté de plus de 2 000 %. Ce ne sont pas de simples chiffres ; ils représentent des millions de violations potentielles de la vie privée visant de vraies personnes.

L’Internet Watch Foundation a également documenté des cas impliquant « de nombreuses images générées par IA représentant des victimes connues et des mineurs célèbres ». Ces contenus nuisibles continuent de se propager, et les parents du monde entier sont de plus en plus inquiets.

Matériel d’abus sexuel sur enfants (CSAM)

Le CSAM désigne tout contenu sexuellement explicite impliquant un enfant. Certaines personnes peuvent télécharger et utiliser des images d’enfants sur Undress AI afin de créer des images sans vêtements. Cette action peut être qualifiée de création de CSAM. Sans le consentement des personnes concernées, cela peut entraîner la diffusion de CSAM.

Et une telle utilisation abusive est non seulement illégale dans de nombreux pays, mais aussi profondément destructrice. La capacité de cette technologie à modifier les images avec une grande précision suscite des inquiétudes quant à son potentiel d’abus dans la création de contenus exploitants.

Préjudice émotionnel et atteinte à la réputation

Imaginez ceci : si quelqu’un publie et partage une image dénudée de vous sur les réseaux sociaux ou d’autres sites, quelle situation préoccupante cela représenterait ! Certaines personnes malveillantes peuvent même utiliser ces photos pour vous menacer ou répandre des rumeurs sur vous, causant ainsi un préjudice émotionnel et réputationnel important.

Par exemple, un rapport récent a mis en lumière le cas d’une adolescente de 15 ans victime de la technologie deepnude, dont des images nues ont été partagées sur Snapchat par un camarade de classe, la laissant traumatisée.

Préoccupations éthiques et de confidentialité

L’utilisation d’Undress AI pour retirer des vêtements soulève des questions d'éthiques et de confidentialité. Bien qu’une notification apparaisse pour rappeler aux utilisateurs d’obtenir le consentement, combien d’entre eux le font réellement ?

Une violation de la vie privée peut survenir si des tiers non autorisés accèdent à des images modifiées. Cela remet en question les normes sociales et les limites morales, et soulève des préoccupations concernant les abus et la diffusion non autorisée d’informations sensibles.

Questions juridiques

Undress AI est-il illégal ? Plusieurs lois, notamment celles interdisant l’utilisation illégale d’images privées et celles relatives à la pornographie, peuvent être enfreintes par la création ou la diffusion d’images modifiées via Undress AI.

Au Royaume-Uni, la création d’images sexuelles deepfake est devenue une infraction pénale. Les contrevenants peuvent encourir des peines de prison si les images sont largement diffusées.

Des criminels tirent des profits directs de ces activités, car des rapports médiatiques montrent que des contenus falsifiés génèrent des profits illégaux atteignant des millions de dollars. La facilité de création de ces images entraîne une large diffusion, causant des dommages graves, ce qui nécessite des stratégies efficaces de prévention.

Partie 4. Réponse des États-Unis : fournisseurs et politiques en action

En mai 2025, le gouvernement américain est passé d’une autorégulation volontaire de l’industrie à une application légale obligatoire avec la signature du Take It Down Act (S.146). Cette loi fédérale criminalise officiellement la publication et la diffusion d’images intimes générées par ordinateur (CGII), ciblant directement la hausse des deepfakes créés sans consentement.

En établissant une norme fédérale uniforme, la loi élimine le précédent « patchwork » de lois étatiques incohérentes, offrant aux victimes une voie juridique simplifiée vers la justice.

Nouvelle responsabilité pour les plateformes et fournisseurs

Le cœur du Take It Down Act repose sur une obligation stricte de suppression sous 48 heures. Pour la première fois, les plateformes et services en ligne doivent agir dans un délai de deux jours après réception d’une notification de victime.

La politique exige que les plateformes aillent au-delà de la simple suppression de liens et qu’elles fassent des efforts raisonnables pour supprimer toutes les copies de contenus sexuels générés par IA sur leur système.

Application et conformité

La Federal Trade Commission (FTC) supervise cette nouvelle ère de responsabilité en matière de sécurité en ligne. La loi définit le non-respect des demandes de suppression comme des « actes déloyaux ou trompeurs », entraînant des sanctions réglementaires importantes. La législation fédérale sur les deepfakes introduit des éléments essentielles notamment :

- Sanctions pénales : poursuites directes contre les créateurs et diffuseurs, avec aggravation des peines pour les contenus impliquant des mineurs.

- Période de transition : les entreprises technologiques disposent d’un an pour automatiser leurs systèmes de détection et de suppression afin de se conformer aux exigences fédérales.

- Mesures proactives : passage obligatoire d’une modération réactive à une prévention proactive des abus numériques.

En codifiant ces exigences, le gouvernement américain impose une réponse directe des fournisseurs technologiques pour réduire les dommages liés à l’exploitation numérique.

Partie 5. Protéger votre enfant : un guide complet

Évaluation : votre enfant est-il en danger ?

L’évaluation de la vulnérabilité de votre enfant doit inclure ses activités en ligne et les risques spécifiques liés à son genre. Commencez par analyser les plateformes utilisées, les applications de chat anonymes et les forums non modérés présentent des risques élevés d’exploitation par IA.

La technologie permet de cibler des groupes spécifiques, car les recherches montrent que 99 % des victimes de deepfakes sans consentement sont des femmes et des filles. Les parents ayant une fille doivent instaurer un dialogue ouvert sur Undress AI comme mesure de protection essentielle.

Prévention : comment rester en sécurité ?

Presque tous les enfants utilisent Internet, et la sensibilisation aux risques en ligne est une compétence essentielle. Cela signifie qu’ils doivent savoir identifier les dangers potentiels et ne pas être facilement trompés ou victimes de chantage.

Les parents doivent leur apprendre à signaler et refuser les contenus inappropriés, à garder leur calme face aux contenus nuisibles et à demander de l’aide à un parent, à un tuteur ou à un adulte de confiance.

Détection : repérer les signaux d’alerte

Pour détecter des situations liées à « Undress AI », il est essentiel d’observer régulièrement tout changement comportemental soudain chez votre enfant.

En plus des variations d’humeur, il faut surveiller des signaux financiers, comme une demande urgente d’argent sans explication claire, souvent liée à du chantage ou à de l’extorsion.

D’autres signaux importants incluent une forte secret autour des appareils, la suppression soudaine des comptes sociaux ou une anxiété après l'utilisation d’Internet.

Si votre enfant manifeste une anxiété inhabituelle liée à Internet ou hésite à partager des photos avec ses amis ou sa famille, il peut avoir été affecté par des contenus malveillants générés par IA.

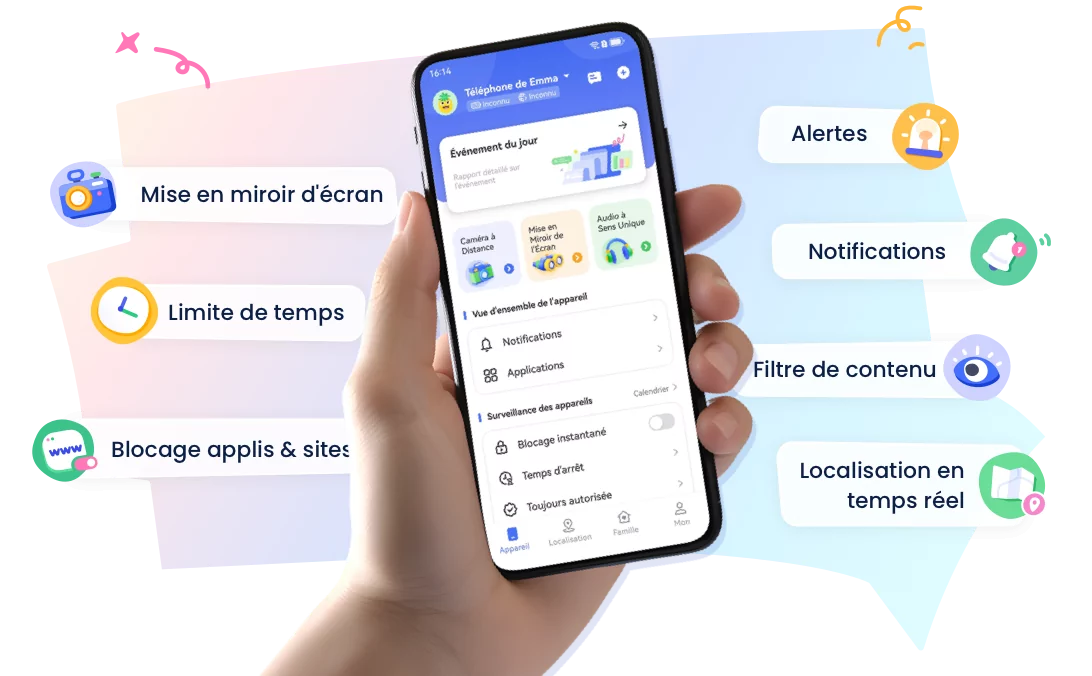

Des outils techniques peuvent apporter une protection supplémentaire. Les solutions comme AirDroid Parental Control permettent de surveiller des mots-clés à risque (comme « undress » ou « nude ») en temps réel et de bloquer l’accès aux sites et applications connus avant qu'un enfant ne soit exposé à un contenu préjudiciable.

Réaction : que faire en cas d’urgence ?

Si vous découvrez que votre enfant est victime d’exploitation numérique, une action immédiate est essentielle. Suivez ces étapes :

- Étape 1. Conserver les preuves (ne pas supprimer !)

- Prenez des captures d’écran en haute résolution en incluant l’identifiant du compte, le contenu des messages et les URL concernées.

- Point clé : ne supprimez pas immédiatement les fichiers originaux. Selon les directives légales de 2026 du Take It Down Act, les métadonnées et en-têtes des messages originaux constituent des « empreintes numériques » essentielles requises par les forces de l'ordre pour retracer la source de la génération par l'IA.

- Étape 2. Lancer la procédure de suppression sous 48 heures

- Déposez une plainte officielle sur Snapchat, X (Twitter) ou Instagram en invoquant le Take It Down Act de 2025. La loi impose une suppression sous 48 heures.

- Étape 3. Utiliser la technologie d’empreinte numérique pour bloquer

- Rendez-vous sur TakeItDown.ncmec.org. Cet outil, géré par le NCMEC, génère une « empreinte numérique » (hachage) unique pour la photo. Cela empêche sa remise en ligne sur les principales plateformes de réseaux sociaux sans que vous ayez à téléverser ou partager la photo elle-même avec qui que ce soit.

- Étape 4. Rechercher une assistance juridique et psychologique

- Signalez l’incident à votre police local, en mentionnant spécifiquement S.146 (Take It Down Act) pour bénéficier d’un soutien au niveau fédéral. Cette loi prévoit des sanctions pénales renforcées pour les contenus impliquant des mineurs. En outre, contactez un thérapeute professionnel spécialisé dans les traumatismes liés au cyberespace afin de traiter toute anxiété sociale ou détresse émotionnelle que votre enfant pourrait éprouver.

Dialogue : Comment engager la conversation ?

Les discussions concernant les faux contenus générés par l’IA et la cybersécurité doivent reposer sur le soutien. Utilisez des questions ouvertes comme celles ci-dessous :

« Mon cœur, j’ai récemment vu un reportage indiquant que l’IA peut falsifier des photos de personnes. Cette technologie est assez inquiétante. Toi ou tes amis avez-vous déjà rencontré de telles images étranges en ligne ? »

« Mon cœur, si jamais tu cliques accidentellement sur quelque chose de ce genre, ou si quelqu’un te menace avec ces fausses images, souviens-toi que ce n’est absolument pas de ta faute. Quoi qu’il arrive, je t’accompagnerai à la police. Il existe désormais des lois pour nous protéger. »

Assurez-vous qu’ils sachent que, si quelque chose se produit, ils ne seront pas en difficulté et que leurs parents seront toujours à leurs côtés. Une communication ouverte demeure essentielle. Grâce à une relation étroite avec la famille, les enfants se sentent à l’aise pour signaler l'harcèlement en ligne.

Conclusion : Undress AI est-il sans danger pour les enfants ?

Non. De nombreuses préoccupations sont associées à Undress AI, notamment la pornographie générée par Undress AI, les risques de harcèlement ainsi que des enjeux moraux et juridiques.

La bonne nouvelle est que les systèmes juridiques s’améliorent dans le monde entier.

Outre le Take It Down Act (S.146) aux États-Unis, le ministère de la Justice du Royaume-Uni a annoncé une nouvelle loi selon laquelle toute personne créant des images deepfake à caractère sexuel sans le consentement d’un adulte fera l’objet de poursuites. Les personnes reconnues coupables encourront également des « amendes illimitées ».

L’Australie a incité le commissaire gouvernemental à la cybersécurité à appeler les établissements scolaires à veiller à ce que tous ces incidents soient signalés à la police en tant que crimes sexuels impliquant des enfants.

Les mesures prises par la Chine concernant l’intelligence artificielle générative comprennent plusieurs dispositions visant à atténuer les préjudices liés aux contenus deepfake créés sans consentement.

Les fournisseurs de services en ligne affinent également les règles de leurs plateformes. Meta a annoncé qu’elle poursuivra en justice le développeur de l’application CrushOnAI, l’accusant de tenter de contourner les restrictions de Meta concernant la promotion d’applications de nudité sur sa plateforme Facebook.

Pour protéger les enfants contre les technologies nuisibles, les parents peuvent les sensibiliser aux dangers et essayer des outils de contrôle parental afin de bloquer ces applications ou sites préjudiciables.

FAQ : Undress AI est-il sans danger pour les enfants ?

Laisser une réponse.